Компанія Google зафіксувала новий тип кібератак, в яких активно використовується штучний інтелект. Цей розвиток подій викликав серйозне занепокоєння серед експертів у сфері кібербезпеки, оскільки зловмисники тепер можуть застосовувати AI для автоматизації атак та вдосконалення своїх методів обману. Згідно з інформацією від фахівців Google, нова форма атак передбачає використання алгоритмів машинного навчання для створення більш складних фішингових схем. Зловмисники здатні генерувати перекон

Компанія Google повідомила про безпрецедентний випадок у сфері кібербезпеки — хакери вперше використали штучний інтелект для пошуку вразливості нульового дня та створення експлойту для її експлуатації. Експерти вважають, що це може стати початком нової епохи кібератак, де AI працюватиме не на захист, а на користь зловмисників.

Про інцидент розповіла командаGoogle Threat Intelligence Group (GTIG), яка займається відстеженням глобальних кіберзагроз. За словами аналітиків, раніше штучний інтелект вже використовувався для автоматизації написання шкідливого ПЗ або створення фішингових кампаній, однак тепер мова йде про значно серйозніший рівень застосування AI.

У звіті GTIG йдеться про те, що хакери змогли використати мовну модель штучного інтелекту для аналізу програмного коду та виявлення так званоївразливості нульового дня. Подібні дефекти є особливо небезпечними, адже розробники програмного забезпечення ще не знають про їх існування, а значить — не мають готового захисту.

Фактично це означає, що система може бути атакована ще до того, як компанія встигне випустити оновлення безпеки. Саме тому zero-day-вразливості високо цінуються серед кіберзлочинців та часто використовуються у складних атаках проти бізнесу, державних структур і великих технологічних компаній.

УGoogleзазначають, що AI не лише допоміг знайти проблему в коді, але й взяв участь у створенні інструменту для обходу захисту та експлуатації знайденої «дірки».

Аналітики GTIG дійшли висновку, що код для експлойту, ймовірно, був створений за допомогою генеративної моделі штучного інтелекту. На це вказувала структура скрипта, його оформлення та навіть специфічні пояснювальні вставки.

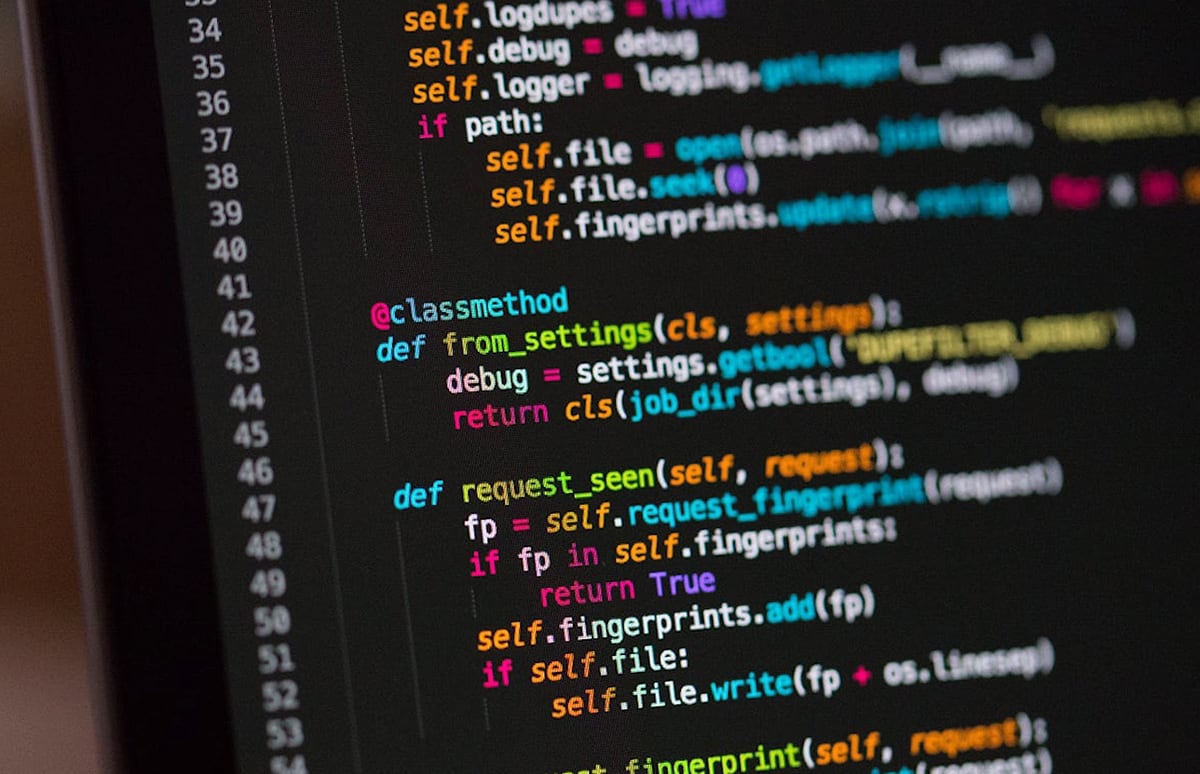

У звіті згадується, що код був написаний у надто акуратному та структурованому стилі Python, який часто характерний саме для AI-моделей. Крім того, в ньому були помічені своєрідні «навчальні» примітки — подібні елементи часто залишаються після генерації тексту мовними моделями.

Цікаво, що в Google окремо підкреслили: для атаки, ймовірно, використовувалася не модельGemini, а інша AI-система.

У документі не називаються ані конкретна група хакерів, ані постраждала сторона. Водночас фахівці Google наголосили, що раніше кіберугруповання з Китаю та Південної Кореї вже демонстрували інтерес до використання штучного інтелекту для пошуку вразливостей у програмному забезпеченні.

Експерти з кібербезпеки вважають, що генеративний AI може суттєво прискорити процес пошуку помилок у коді. Якщо раніше для цього потрібні були великі команди спеціалістів і багато часу, то тепер частину роботи здатна виконувати нейромережа — швидше, дешевше та майже безперервно.

На думку аналітиків, це створює серйозний виклик для всієї індустрії кібербезпеки. Компаніям доведеться адаптувати свої системи захисту до нової реальності, де штучний інтелект стане інструментом не лише для захисників, а й для нападників.

Провідний аналітик GTIG Джон Хультквіст в інтерв’юThe New York Timesзаявив, що зафіксований випадок може бути лише першою публічно відомою ознакою значно масштабнішої проблеми.

«Це приклад того, що може статися далі. Ми переконані, що бачимо лише верхівку айсберга. Насправді проблема може бути значно серйознішою, і це лише перший доказ, який вдалося зафіксувати», — зазначив Хультквіст.

У середовищі кібербезпеки вже давно обговорюють ризики, пов’язані з AI-моделями. Однак до останнього часу більшість реальних випадків стосувалася автоматизації фішингу, генерації шкідливих листів або створення вірусного коду низького рівня.

Тепер же ситуація переходить у значно небезпечнішу площину — AI починає допомагати знаходити фундаментальні слабкі місця у програмному забезпеченні.

Фахівці звертають увагу, що штучний інтелект здатний аналізувати величезні обсяги коду набагато швидше за людину. У перспективі це може призвести до появи автоматизованих систем, які шукатимуть нові вразливості практично без участі людини.

Для технологічних компаній це означає необхідність інвестувати ще більше ресурсів у превентивний захист, аудит коду та AI-системи моніторингу. Інакше гонка між кіберзлочинцями та спеціалістами з безпеки може перейти на абсолютно новий рівень.

Водночас деякі аналітики вважають, що штучний інтелект стане не лише проблемою, а й головним інструментом оборони. Уже зараз великі IT-компанії використовують AI для автоматичного пошуку помилок у коді та прогнозування потенційних атак ще до їх появи.

Однак випадок, про який повідомила Google, показує: перевага AI більше не належить виключно захисникам.